医療福祉ロボティクス・メカトロニクス研究者

岩田 浩康(いわた ひろやす)/理工学術院教授

グローバルロボットアカデミア研究所所長

身体装着型ロボット「第3の腕」

「人の技能と心身機能を拡張する人間支援ロボットテクノロジー(RT)」をコンセプトに多彩な研究活動に取り組む岩田浩康教授。シリーズ第2回は「第3の腕を直感的に操作するためのインタフェース」です。

「人の技能と心身機能を拡張する人間支援ロボットテクノロジー(RT)」をコンセプトに多彩な研究活動に取り組む岩田浩康教授。シリーズ第2回は「第3の腕を直感的に操作するためのインタフェース」です。

もう一本、手があれば便利なのに

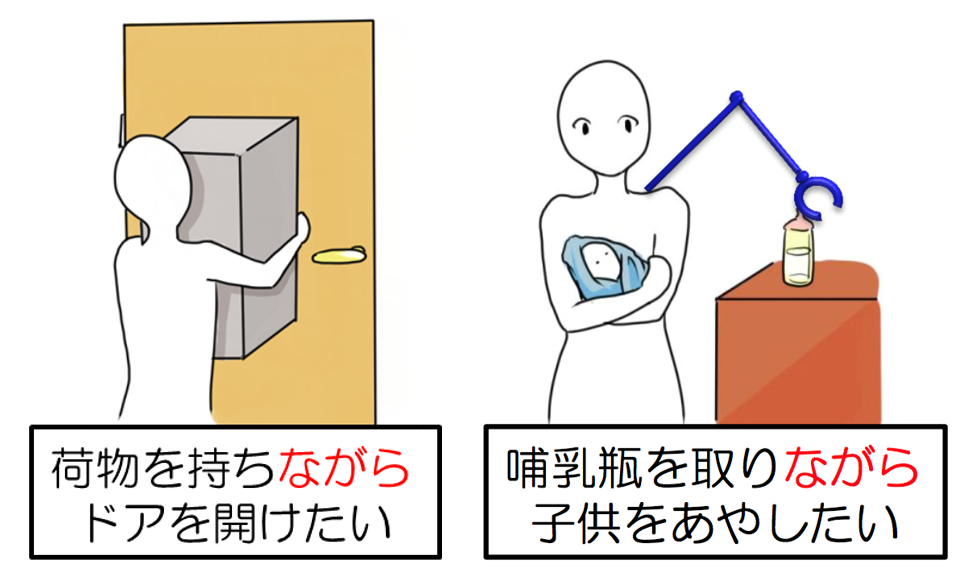

例えば、宅急便などで届いた大きな荷物を玄関先で受け取り、家に入ろうとしました。ところが両手が荷物でふさがっているために、ドアを開けることができません。あるいは、両手で赤ちゃんを抱っこしているときに、哺乳瓶を取ってミルクを飲ませてあげようと思いました。できればそのままミルクを飲ませてあげたいけれど、片手で抱っこしながら、片手を哺乳瓶に伸ばすのは危険です。その他にも足を骨折して両手で松葉杖をついているときなど、雨の日は外出を諦めなければなりません。2本の手で松葉杖をつきながら、傘をさすのはとても難しいためです。このように思い通りの動きができないのは、人の腕が2本しかないからです。だったら、もう1本腕があれば便利だとは思いませんか。第3の腕(ロボットアーム)を思いついた理由はごく単純な想いから、日々の暮らしを少しでも便利にしたいのです。そのヒントは、実は子どもの頃に好きだったアニメ『キン肉マン(※1)』に出てきたアシュラマンです。

図:生活支援に実益を与える技術の開発。「ながら動作」ニーズが第3の腕を生み出した(出典:岩田研究室)

ハードとソフト、今後の課題

使いやすい第3の腕を実現するには、ハードとソフトの両面において、いくつかの要件を満たす必要があります。ハード面で求められるのは、身体に馴染むロボットアームの開発です。これは既存の産業用ロボットの技術などを応用すれば、それほど難しいテーマではありません。問題はソフト、要するに体に装着したロボットアームを意のままに動かすインタフェースの開発です。急速に発達しスマホなどにも搭載されている音声認識技術を使えば済むのではと直観的には思います。ところが、例えば目の前に複数のお皿があり、その中の一枚を手に取りたい場合にどう指示すればよいか。音声での指示では、取ってほしい皿を指示するのにまどろっこしい思いをすることになります。

顔面ベクトルを使い、その精度を高める

目標物を正確に指示するには、どうすればよいか。いろいろ思案した結果、閃いたアイデアが『顔面ベクトル』です。要は顔を目標に向けることで方向を指示するのです。

何枚か置いてあるお皿の中で欲しいものに顔を向ける。この行為によりロボットアームに目標を認識させた上で「その皿を取って」と音声で指示を出す。実現すれば、例えば両手でミンチ肉とパン粉をこねてハンバーグを作っている最中に、第三の腕を使って塩やコショウで味を整えるなど便利になります。

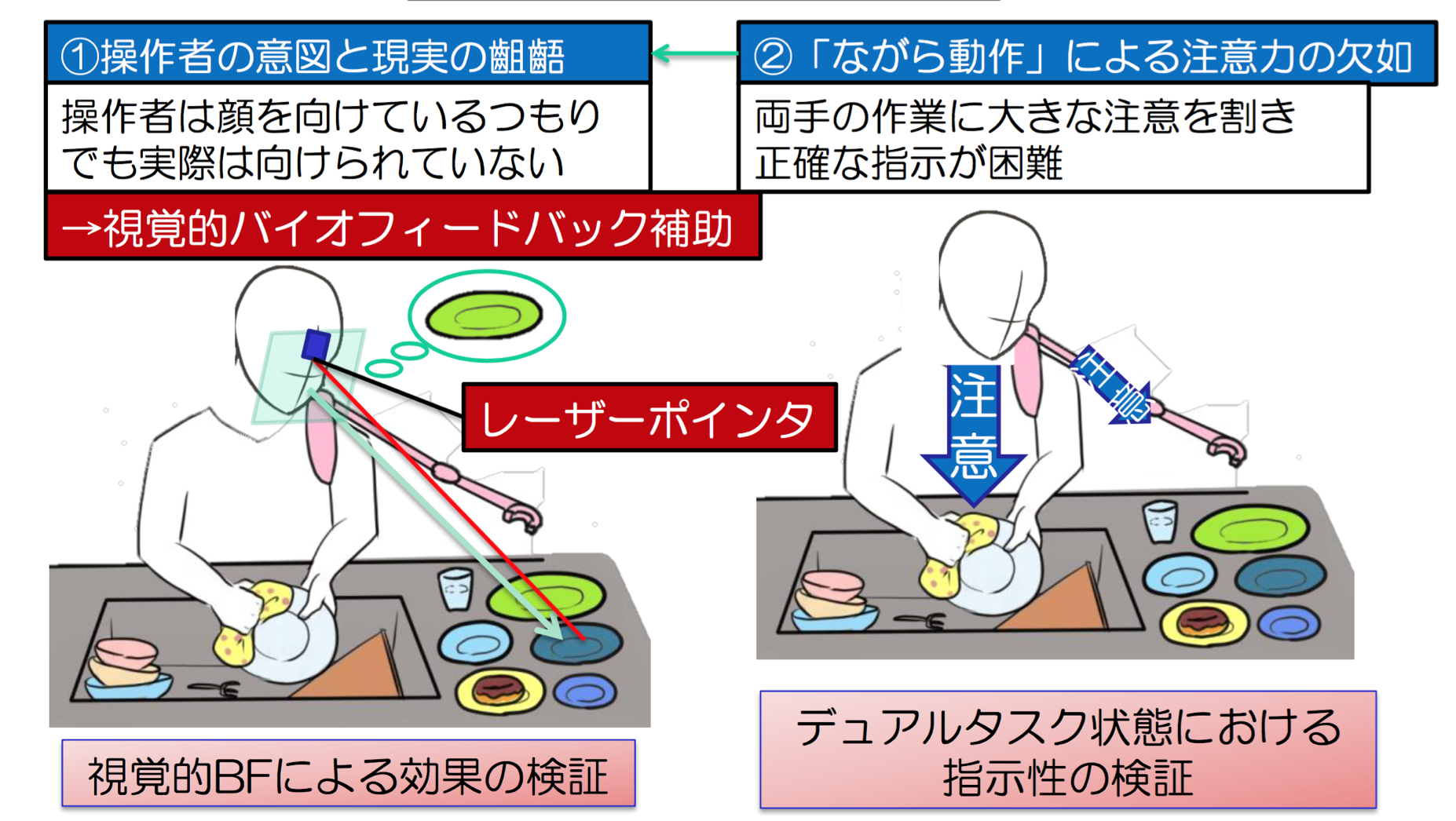

基本的なアイデアとインタフェースが固まりつつある中、残された課題は顔面ベクトルによる指示の精度を高めること。解決すべきは次の2点、1つは操作者の意図と動作の齟齬を解消することであり、もう1つは指示するのに注意が取られ過ぎないことです。

図:顔面ベクトルによる指示と懸念点(出典:岩田研究室)

意図と動作の齟齬とは、例えば操作者は目標物に顔を向けているつもりでも、実際には顔を正確に目標物に向けられていないため、ロボット側が目標を正しく認識できないようなケースを意味します。「ながら動作」の問題とは、両手を使って何らかの作業をしている場合、操作者は自分の手元にも視線を向ける必要があるため、視線による正確な指示を行えないようなケースに相当します。

こうした問題解決のカギを握るのが知能化技術です。最初にきちんと指示を出してロボットアームに経験を積み重ねさせることで、機械学習(※2)を促します。この学習体験を元にして、ある程度あいまいな指示を受けた場合でも、ロボットアーム側で予測・修正して望みどおりの行動を取れるようにするフレームワーク作りに取り組んでいます。

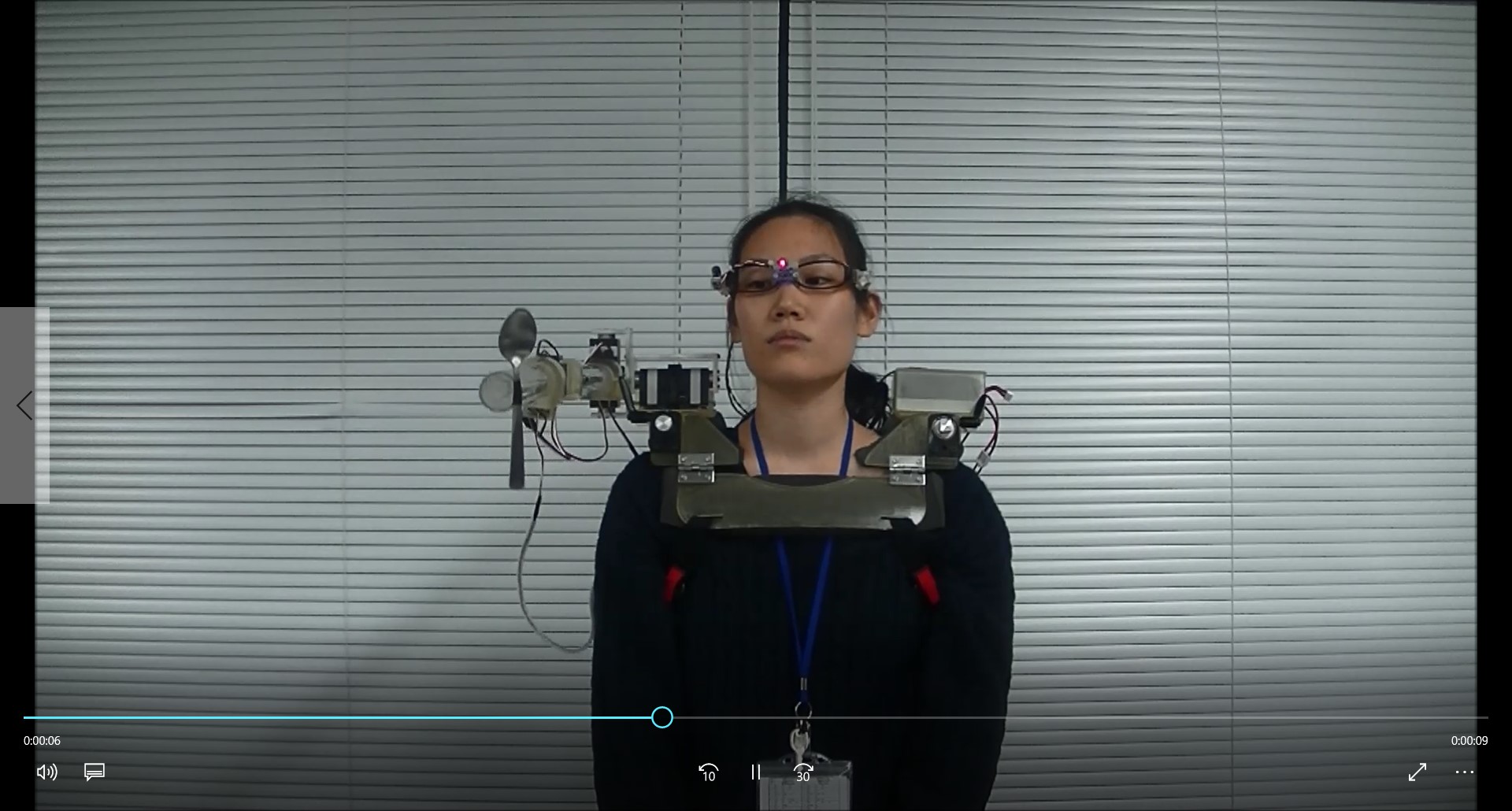

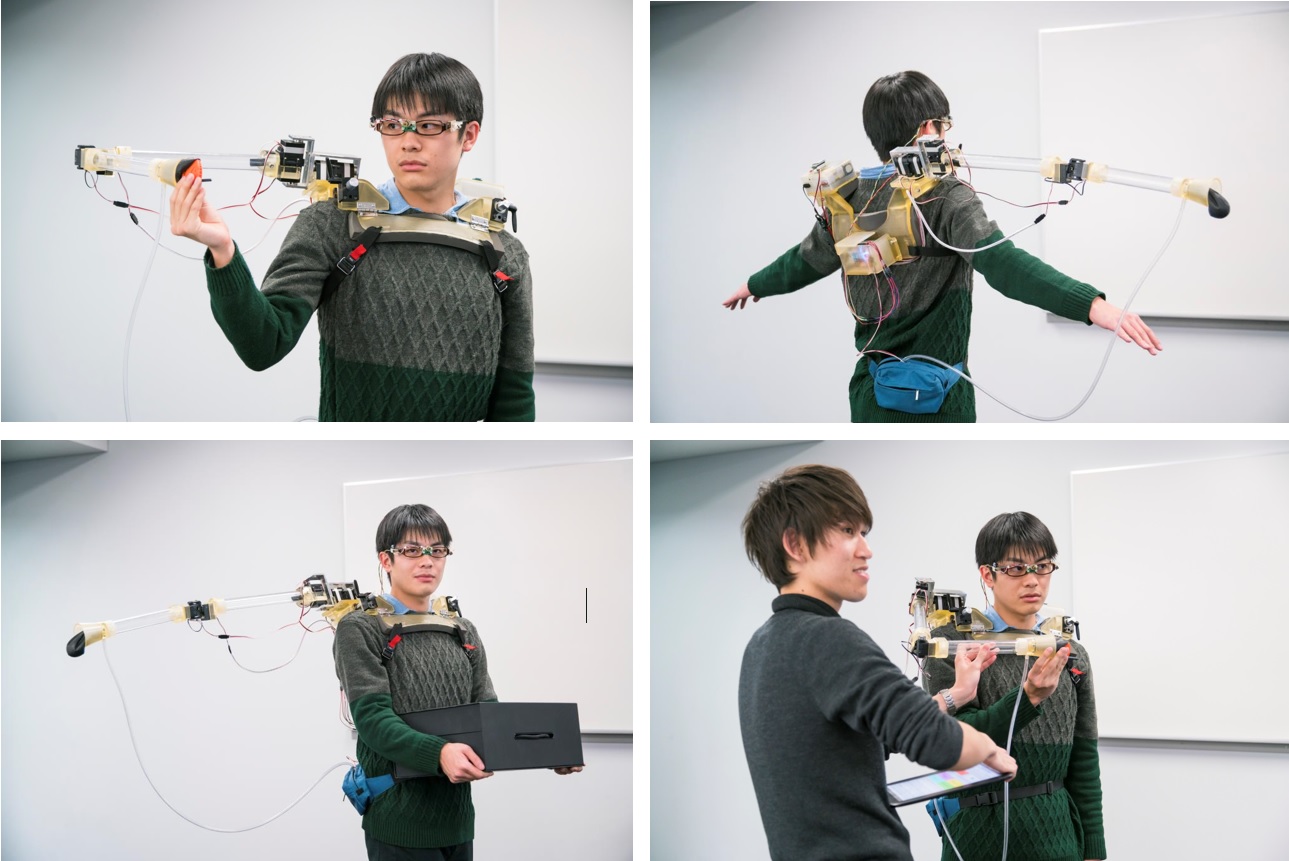

写真:身体装着型ロボット「第3の腕」デモンストレーション①

写真:身体装着型ロボット「第3の腕」デモンストレーション②

医療用途に、また義手としても広がる可能性

ハードウエアとしてのロボットアームは、既にプロトタイプができています。ロボットアームを人体に装着するためのインタフェースもできつつあり、残る課題は指示を伝えるためのソフト開発と、指示を受けて正確に作動させるための知能化技術です。いまVR(バーチャルリアリティ※3)環境でシミュレーションを行い、改良を重ねています。

写真:キッチンタスクのVR環境

ロボットアームに出す指示の精度が高まっていけば、ほかにもさまざまな用途が考えられます。その一例が医療現場での活用です。現状では手術の際に、執刀医の操作状況を助手がカメラで撮影し、執刀医はモニターに映し出された映像を見ながら手術を進めています。このようなケースで、執刀医が自分でカメラを操作できれば、より思いどおりに見たいところを確認しながら手術を進めることができるでしょう。あるいは、現状の手術のやり方は、執刀医の腕が2本であることを前提として定められていますが、3本の腕を前提とすれば手術の進め方自体が根本的に変わる可能性もあります。事故などにより腕を失った人には、ロボットアームが思い通りに動かせる義手となる可能性もあります。さらに発想を広げるなら、何も腕を3本に限る必要もありません。少し荒唐無稽かもしれませんが、アシュラマンや千手観音のように、何本もの腕を身につけて、そのすべてを思い通りにコントロールできれば、人の可能性はどこまで広がるでしょうか。

第3の腕が実現した際に、人の体はどのように変わっていくでしょう。先天的に手の指が6本ある人の脳では、6本目の指の動きを司る脳の領域があるといわれています。だとすれば、第3の腕を身体化できたとき、その人の脳内の運動野や感覚野に第3の腕の領域ができるのではないか。もし、脳内に新たな領域ができたりすれば、新たな脳科学の発見につながります。

私が幼いころに抱いた疑問、それは「アシュラマンはどうやって自分の腕をコントロールしているのか」でした。心の中にずっと持ち続けてきた疑問が、自分の周りにある技術と結びついた結果、第3の腕として実を結ぼうとしています。私の発想や研究の背景にはいつも、世の中に役立つモノを創り出したいという思いがあります。

次回は、人間支援ロボットテクノロジー(RT)の中で、2020年東京オリンピックへ向けた「スポーツ技能習熟支援システム」を紹介します。

写真:中央が岩田先生。第3の腕を囲んで研究室メンバーと。海外から視察にきた研究者と定番のワセダWポーズ!

☞1回目配信はこちら

☞3回目配信はこちら

☞4回目配信はこちら

脚注

※1 キン肉マン:漫画家ゆでたまご氏による漫画作品。1979年から週刊マンガ誌で連載が始まり、子どもたちの人気を集めた。

※2 機械学習:膨大なデータから反復的に学習し、データに潜むパターンを発見する。学習結果を新たなデータに当てはめることで、パターンに従った答えを出す。

※3 VR(バーチャルリアリティ):仮想現実と訳され、コンピュータによって作り出された世界を、五感を通じて実際に体感する技術、あるいはその世界のこと。

プロフィール

岩田 浩康(いわた ひろやす)

岩田 浩康(いわた ひろやす)

2002年早稲田大学大学院理工学研究科機械工学専攻博士課程修了、博士(工学)、2004年同大学講師、2006年同大学准教授、2014年同大学創造理工学部総合機械工学科教授、2015年同大学グローバルロボットアカデミア研究所所長、日本機械学会(代議員),日本コンピュータ外科学会(評議員)、日本バイオメカニズム学会(幹事)、日本ロボット学会(評議員)、日本バイオフィードバック学会(理事),計測自動制御学会(代議員),IEEE,EMBS等に所属。人間を支援するロボット技術(Robot Technology;RT)をキーワードに、リハビリ支援RT、医療支援RT、スポーツ習熟支援RT、知能化建機ロボット、新素材応用RT等、先端的研究を数多く手がけ、国内外から高い評価を得ている。詳しくは岩田研究室

主な研究業績

- M.OKAMOTO,M.KUROTOBI,S.TAKEOKA,J.SUGANO,E.IWASE,H.IWATA,T.FUJIE,“Sandwich fixation of electronic elements using free-standing elastomeric nanosheets for low-temperature device processes” J.Mater.Chem.C,Feb,2017

- H.HAYATA,M.OKAMOTO,S.TAKEOKA,E.IWASE,T.FUJIE,H.IWATA,“Printed high-frequency RF identification antenna on ultrathin polymer film by simple production process for soft-surface adhesive device” Jpn.J.Appl.Phys.,vol.56,no.5S2,pp.05EC01,May,2017

- Ito K, Sugano S, Takeuchi R, Nakamura K, Iwata H,“Usability and performance of a wearable tele-echography robot for focused assessment of trauma using sonography” Medical Engineering and Physics,vol.35,no.2,p165-171,2013

- Iwata H, Sugano S,“Human-robot-contact-state identification based on tactile recognition” IEEE Transactions on Industrial Electronics,vol.52,no.6,p1468-1477,2005

- Iwata H, Sugano S,“Design of human symbiotic robot TWENDY-ONE”Proceedings-IEEE International Conference on Robotics and Automation,p580-586,2009